林鳞 编译自 Forbes量子位 出品 | 公众号 QbitAI

今天的故事发生在麻省理工大学(MIT)Media Lab,一项有史以来规模最大的无人车道德研究首次透露成果。

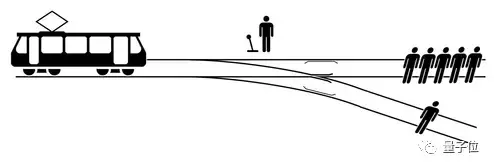

而调查内容正是无人车无法绕过的"电车难题"。该不该牺牲一人而拯救五人,这是个大问题。

2016年,MIT的研究人员推出了一个叫"道德机器"的博弈测试,涉及不同性别、年龄、甚至物种等在过马路时的"电车难题"问题。400万名志愿者必须根据多种场景下做出选择,是牺牲车上的乘客还是过路的行人?是牺牲老年人,还是年轻人?

不同困境

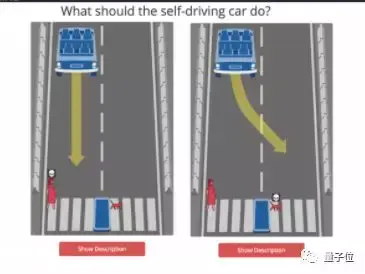

在下面两种情况下,你希望无人车将直行还是转向?

MIT教授Iyad Rahwan团队发现,在情况比较简单时,比如在保护成人还是儿童的问题上,结果非常明确——绝大多数人更倾向挽救儿童的生命。

穿越道路的行人年龄越大,相较之下挽救他们的人就越少。

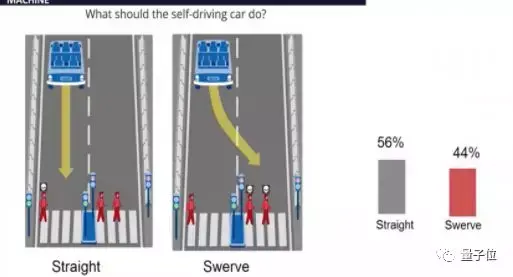

再来看另外一种情况,在这两种情况下,你希望无人车直行还是转向?

直行,意味着牺牲车上的乘客;转弯,意味着牺牲人行道上行走的路人。

结果显示,61%的投票者倾向直行,只有39%的人愿意转弯牺牲行人。

类似的问题还有很多,场景越是复杂,被调查者就越纠结。

在选择牺牲一个不违规过马路的行人,或者牺牲两个违规过马路的行人时,投票结果相对均匀。

通用机器伦理?

更有趣的是,研究人员发现,国家和地区不同,选择结果差异也很大。

当奔驰一方曾表示"奔驰汽车以保护车里乘客的安全为重"时,也着实引发了一场言语风波。

Rahwan表示,由于每个人的道德标准不一,谁对谁错自然难以分清。这似乎证明了符合阿西莫夫小说中的通用机器伦理不存在。

对了,如果感兴趣,你也可以来参加这项测试。科学移步"道德机器"项目官网,你也能亲自感受一下无人车设计中的道德难题,还可以选择中文版~

地址给你:

Moral Machine— 完 —

欢迎大家关注我们的专栏:量子位 - 知乎专栏

诚挚招聘

量子位正在招募编辑/记者,工作地点在北京中关村。期待有才气、有热情的同学加入我们!相关细节,请在量子位公众号(QbitAI)对话界面,回复"招聘"两个字。

量子位 QbitAI · 头条号签约作者

վ'ᴗ' ի 追踪AI技术和产品新动态

没有评论:

发表评论